Facebook je prvič objavil podatke o rezultatih prepoznave in preprečevanja neprimernih, sovražnih ter nasilnih vsebin. Podatki niso spodbudni: več kot četrtina Facebook računov v primerjavi z mesečnimi uporabniki omrežja je lažna, narašča pa tudi število objav s terorističnimi vsebinami.

Poročilo so objavili po tem, ko je Facebook okrepil način prepoznave tovrstnih objav. Obljubili so tudi večjo transparentnost ter odgovornost do uporabnikov po škandalu uhajanja osebnih podatkov v politične namene.

Facebook se neprestano sooča z odločitvami, kaj je na največjem družbenem omrežju z več kot dve milijardi mesečno aktivnih uporabnikov dovoljeno in kaj ni. V ta namen že obstajajo zapisani standardi Skupnosti, ki opredeljujejo dovoljene objave od besedila do slik in videoposnetkov.

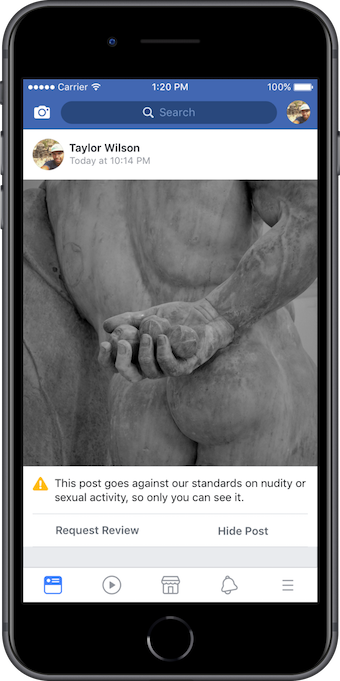

Uporabniki se lahko po novem pritožijo na Facebookovo odstranitev vsebine.

Prvič razkrili tudi interne smernice za preprečevanje neprimernih objav

Konec aprila pa je Facebook prvič objavil tudi svoje interne napotke in navodila, kako obravnavati občutljive vsebine. Zdaj se lahko tudi uporabniki pritožijo na Facebookov proces obravnave vsebin, kar omogoča dvojno preverjanje primernosti vsebin.

Facebook se zaveda težavnosti pri prepoznavi kršitev, zato si pomagajo s kombinacijo umetne inteligence, poročil uporabnikov, objave pa dodatno preučuje več kot 7500 zaposlenih, ki delajo neprestano v več kot 40 jezikih. Uporabnik se lahko pod odstranjeno vsebino pritoži in zahteva ponoven pregled in v primeru ugoditve se vsebina povrne na Facebook.

Na milijone neprimernih objav in lažnih profilov dnevno

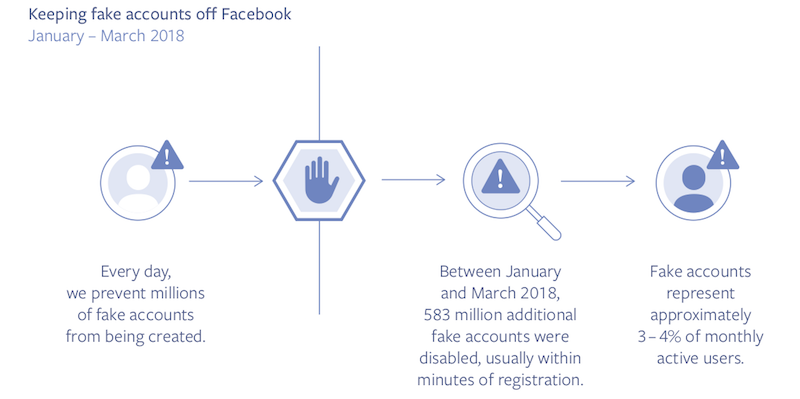

V prvem četrtletju 2018 je Facebook odstranil 837 milijonov vsiljivih vsebin, od katerih naj bi skoraj vse zaznal, preden so jih uporabniki označili kot neprimerne. Posledično je Facebook v istem obdobju onemogočil približno 583 milijonov lažnih profilov, večino že nekaj minut po odprtju.

Dnevno sicer lažne profile skuša ustvariti več kot 6,5 milijona ljudi.

Težava pri ugotavljanju sovražnega govora

Pri sovražnem govoru je Facebookova naloga težja, saj trenutna tehnologija še ne zmore primerno zaznati tega načina govora, zato večino povratnih informacij pošljejo uporabniki. Takih primerov je bilo v prvem četrtletju letos za približno 2,5 milijona.

V primerjavi z zadnjim četrtletjem 2017 pa je število vsebin, ki merijo na terorizem, naraslo z 1,1 milijona objav na 1,9 milijona objav v prvem četrtletju letos.

Nekaj ključnih dejstev o neprimernih vsebinah in zlorabah na Facebooku.

Obljuba dela dolg

Facebook mora vpeljati še številne izboljšave, saj trenutna raven umetne inteligence še ne zna učinkovito zaznati konteksta vsebin, za prepoznavo pa potrebuje veliko več podatkov kot človek. To na Facebooku predstavlja večji izziv, saj so podatki na voljo v preveč raznolikih oblikah in v številnih jezikih.

Objavljeno poročilo in vse izjave za javnost v zadnjih tednih pa jasno kažejo na obljubo izvršnega direktorja Marka Zuckerberga pred ameriškim kongresom aprila letos, da bo omrežje postalo bolj transparentno in odgovorno do uporabnikov. “Ne bomo preprečili vseh napak ali zlorab, vendar trenutno delamo preveč napak pri okrepitvi naših pravil in pri preprečevanju napačne uporabe naših orodij za zaščito uporabnikov,” je dejal v začetku leta.

Mitja Godnič